Le jour d’Halloween, on aime se faire peur. Et une actualité récente passée pour moins inaperçue nous a donné quelques frissons. Bina48, un robot enseignant qui avait déjà donné des cours de niveau collège, a réussi à co-enseigner un cours à un niveau universitaire et sur la théorie de la « guerre juste et l’usage de l’intelligence artificielle dans la société ». L’expérience a été menée par l’Académie militaire US à West Point. D’après William Barry, le professeur en charge de cette expérience, il s’agissait de déterminer « si une intelligence artificielle peut subvenir à un modèle d’enseignement de type sciences humaines. » L’objectif était de voir si le robot en question était susceptible d’améliorer la compréhension d’une centaine d’étudiants, ainsi que de capter leur attention. Afin de préparer le cours les deux professeurs en charge l’ont alimenté avec des éléments sur l’éthique, la philosophie politique, en plus du plan défini par le professeur Barry. Le robot avait pour consigne de ne pas aller consulter Wikipedia ou l’Encyclopédie de philosophie de Stanford. Quand il enseigne Bina48 utilise ses connaissances acquises et le plan de sa leçon. Si un étudiant a une question il est capable de lui répondre. D’après le professeur Barry : « avant la classe, les cadets pensaient que ça allait être amusant ou un moment de détente… mais ils ont été stupéfiés de constater qu’elle était capable de répondre aux questions avec nuance. La partie intéressante étant que les cadets prenaient des notes ».

Quelques décades avant que l’IA ne prenne notre place ?

On pensait que l’IA menaçait surtout les chauffeurs de taxi, on découvre, qu’elle a aussi dans son viseur les professeurs de philosophie…. On ne pourra alors s’empêcher de penser aux nombreuses prophéties sur les robots surpassant l’homme dans absolument tous les domaines. L’une des dernières en date étant celle de Yuval Noah Harari dans Homo Deus. Le prof d’histoire pose trois principes : l’homme est un algorithme ; les calculs algorithmiques restent indifférents aux matériaux des supports qui les effectuent ; en toute conséquence, on a toutes les bonnes raisons de penser qu’un jour des algorithmes non organiques seront à même de répliquer, voire, de surpasser les algorithmes organiques. Après avoir posé ces trois principes, l’auteur du best-seller Sapiens affirme : « Vrai, il y a de nombreuses choses que les algorithmes non organiques font mieux que les algorithmes organiques, et les experts ont déclaré de manière répétitive qu’il resterait pour toujours hors d’atteinte des algorithmes non-organiques. Mais il s’avère que le ‘à jamais’ veut souvent dire pas plus qu’une décade ou deux. » Harari, prend l’exemple de la reconnaissance faciale qui a souvent été citée, pour montrer que même les bébés s’en sortaient mieux que les puissants ordinateurs ; or il existe aujourd’hui des programmes de reconnaissance faciale qui sont plus efficaces et plus rapides que n’importe quel humain. Et l’auteur du best-seller Homo Sapiens d’enchaîner les exemples de domaines ou l’IA surpasse l’homme, des jeux à la gestion de fortune en passant par le sport, la médecine, le droit…. Aucun secteur ne sera épargné, et il va même jusqu’à imaginer des algorithmes prenant eux-mêmes les décisions au sein de comités de direction d’entreprises tentaculaires pour employer, manager et licencier des hommes. Pour appuyer son raisonnement, il fait référence aux travaux de Carl Benedikt Frey et Michael A. Osborne, deux chercheurs d’Oxford, qui, en 2013, dans l’ouvrage « The future of employment » affirmaient que 47 % des jobs US étaient susceptibles d’être remplacés par une intelligence artificielle dans les vingt années qui viennent. Le prof de philo qui se croyait encore épargné jusque là se fait désormais du souci.

La perte de la maîtrise

À cette question récurrente de la supériorité de la machine qui prend la place de l’homme s’ajoute celle de l’Intelligence Artificielle militaire. On se rappellera qu’en 2015, plus de 1 000 experts en robotique et en IA avaient signé une lettre pour alerter sur le développement des armes autonomes, susceptibles d’ôter la vie. Des personnalités telles qu’Elon Musk, Noam Chomsky ou encore Stephen Hawking s’étaient engagés pour cette cause. Très récemment, Google a également montré sa grande considération pour le problème en abandonnant le développement du Projet Maven, une solution de reconnaissance faciale en collaboration avec le Pentagon. Bien évidemment les applications de l’IA dans le domaine de l’armement sont incomparablement plus effrayantes que celles évoquées dans le domaine de l’enseignement et on aura moins peur d’un robot enseignant la « guerre juste » que celui qui la fera.

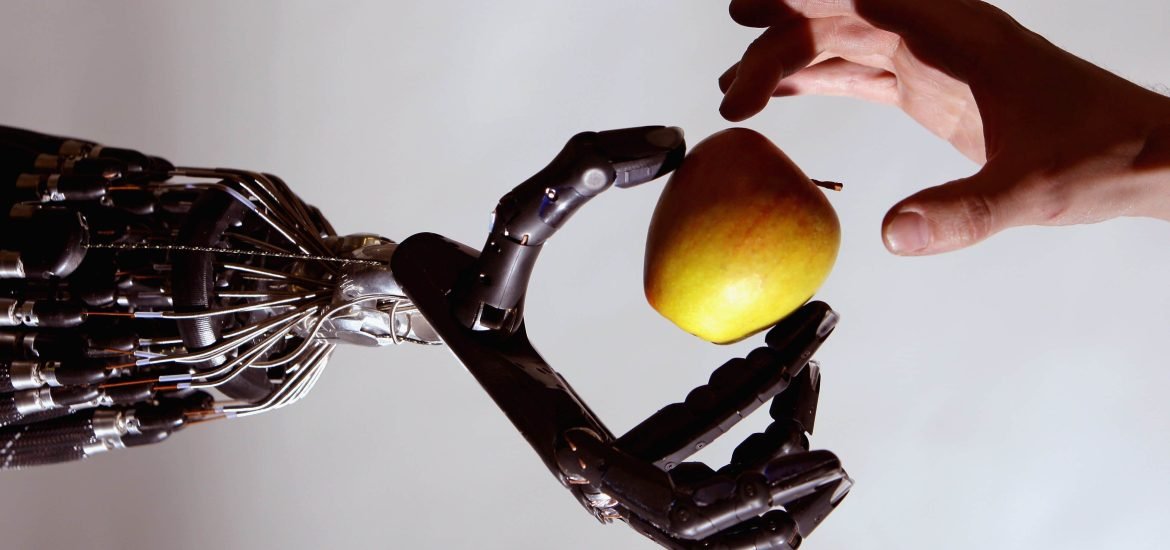

Mais cela ne nous empêche d’avoir une réflexion un peu plus profonde et de constater que les deux types d’applications sont également fascinantes, suscitant également un mélange de peur et d’admiration. Les machines vont prendre nos emplois. Elles vont devenir incontrôlables. Il y a deux angoisses fondamentales qui sont liées l’une à l’autre. Mais en deçà de la perte d’emploi, ou de la crainte suscitée par une arme de destruction surpuissante, se trouve une autre peur plus fondamentale. Celle de porter à l’existence un être totalement libre et qui pourrait un jour échapper à notre contrôle. Imaginez un robot philosophe qui pense par lui-même et dépasse le résultat de notre programmation en s’émancipant de celle-ci. Ou un robot tueur qui échappe à son maître et rompt l’algorithme qui l’oblige à respecter les lois d’Asimov. On le voit, c’est la question de l’absence de maîtrise qui est ici en jeu. Alors que la technologie nous a habitué à aller vers toujours plus de maîtrise et de contrôle de la nature, nous en sommes arrivés à un stade où nous nous posons la question de notre capacité à rester maître de nos inventions. Ce questionnement nous renvoie aux principe de précaution et aux réflexion de Hans Jonas. Nous craignons que quelque chose ne nous échappe. Si on revient à la thèse développée dans Homo Deus, selon Harari, la thèse de l’absence de maitrise finira par l’emporter : viendra un jour où les algorithmes que nous avons créés prendront le pouvoir sur les « algorithmes biologiques que nous sommes ». Mais n’y a-t-il pas une contradiction ? En effet, comment des êtres non-libres (c’est l’hypothèses soutenue par Harari) pourraient-ils donner un jour naissance à des êtres qui se libèrent d’eux ? La prémisse de l’absence de liberté posée par l’auteur n’est-elle pas discutable ? Et au cas où, cette angoisse est-elle véritablement fondée ? Rien n’est moins certain. C’est là un autre débat, aussi pour poursuivre la réflexion nous vous invitons à lire l’excellente analyse de Marc Rameaux, notre spécialiste d’intelligence artificielle.

C’est des robots qui ont donné leurs cours de philo aux auteurs de l’article, non ?